La relatività generale è una delle teorie tecnicamente più difficili, perché richiede conoscenze e abilità matematiche non comuni. Tuttavia, è possibile calcolare con buona precisione gli effetti relativistici indotti dalla curvatura dello spazio-tempo e persino ricavarne la formula con pochissimi, semplici, argomenti. Sappiamo dalla relatività ristretta che in un sistema che si muove rispetto a… Continua a leggere Come sembrare un genio

Tag: fisica moderna

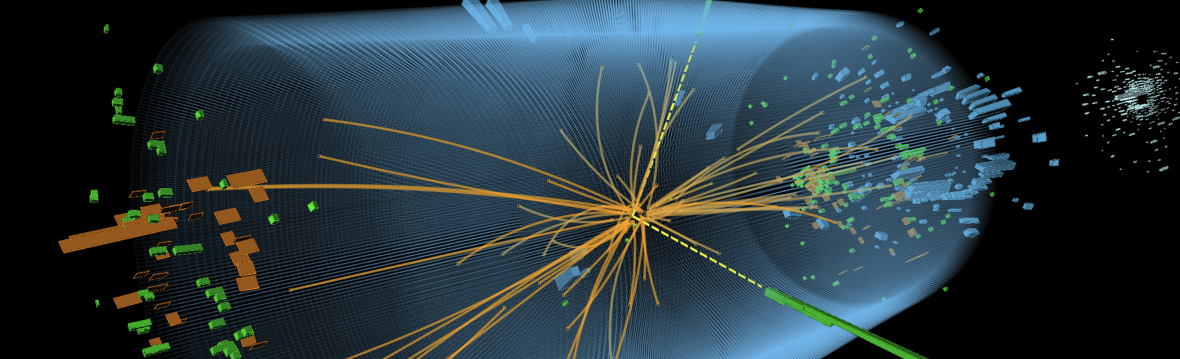

Il meccanismo di Higgs

Se si ha una conoscenza, anche solo elementare, della fisica, è molto probabile che non si sia soddisfatti delle spiegazioni metaforiche del ruolo del bosone di Higgs nel "dare massa alle altre particelle". In fondo, non spieghiamo la gravità e l'elettromagnetismo usando metafore. Di solito scriviamo equazioni il cui significato è molto chiaro e preciso,… Continua a leggere Il meccanismo di Higgs

La distribuzione di Fermi-Dirac

Enrico Fermi divenne famoso, nella comunità dei fisici del tempo, per aver pubblicato, nel 1926, un articolo nel quale calcolava la distribuzione in energia delle particelle identiche con spin semintero. Nello stesso anno, ma poco più tardi, anche Paul Dirac arrivò indipendentemente allo stesso risultato e per questo la distribuzione si chiama oggi di Fermi-Dirac.… Continua a leggere La distribuzione di Fermi-Dirac

Per un nuovo modo d’insegnare la meccanica quantistica

episodio 5: il collasso della funzione d'onda La funzione d'onda fu introdotta nei primi anni dello sviluppo della meccanica quantistica come soluzione dell'equazione di Schrödinger. I fisici hanno faticato un po' a trovarne il significato, ma alla fine hanno accettato di interpretarla come l'ampiezza di probabilità di trovare una particella a una data coordinata. I… Continua a leggere Per un nuovo modo d’insegnare la meccanica quantistica

Per un nuovo modo d’insegnare la meccanica quantistica

episodio 4: la fisica quantistica dei campi La dualità onda-corpuscolo è, a mio parere, il concetto più sbagliato introdotto con la meccanica quantistica, nonostante sia molto diffuso. È del tutto normale che nella scienza si formulino concetti che, alla fine, si rivelano fallaci. È però sbagliato continuare ad usarli inutilmente. La dualità fu introdotta all'inizio… Continua a leggere Per un nuovo modo d’insegnare la meccanica quantistica

Per un nuovo modo d’insegnare la meccanica quantistica

episodio 3: la natura dei fasci di elettroni Probabilmente il concetto più difficile della meccanica quantistica è la dualità onda-particella. Secondo la maggior parte dei libri di testo, la luce ha una duplice natura: è (si comporta come) una particella in determinate circostanze e (come) un'onda in altre condizioni. Allo stesso modo, gli elettroni sono… Continua a leggere Per un nuovo modo d’insegnare la meccanica quantistica

Per un nuovo modo d’insegnare la meccanica quantistica

episodio 2: forze e interazioni Questo è il secondo post di una serie in cui invito a un drastico, ma graduale, cambiamento nel modo in cui insegniamo sia la meccanica quantistica che quella classica. L’idea è che continuare ad insegnare la meccanica quantistica come una totale rivoluzione della fisica sia controproducente e, di fatto, trasmette… Continua a leggere Per un nuovo modo d’insegnare la meccanica quantistica

Per un nuovo modo d’insegnare la meccanica quantistica

episodio 1: il concetto di stato La meccanica quantistica è spesso insegnata come una “rivoluzione”, facendo leva sui suoi aspetti paradossali. In parte, ciò è dovuto al fatto che gli insegnanti (i libri) tendono a seguirne lo sviluppo storico (il che non sempre è una buona idea); in parte al presupposto, sbagliato, che questi aspetti la… Continua a leggere Per un nuovo modo d’insegnare la meccanica quantistica

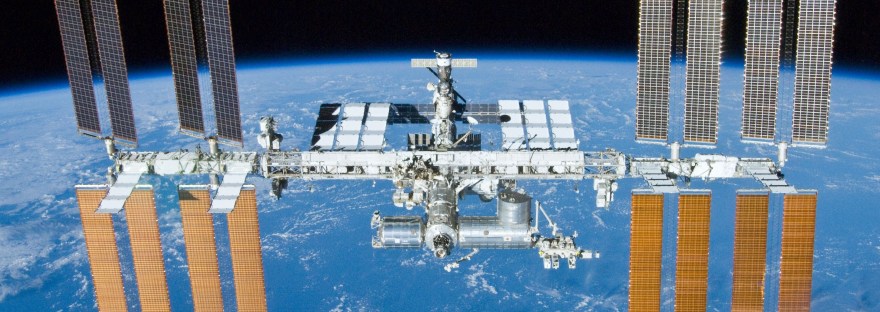

Osservare i raggi cosmici

I raggi cosmici sono particelle di alta energia che provengono dallo spazio che, urtando con i nuclei dell'atmosfera, danno origine a numerose nuove particelle che si propagano verso la Terra decadendo, cioè trasformandosi in altre particelle, man mano che procedono nella loro corsa. La produzione di nuove particelle è un fenomeno quantistico reso possibile dalla… Continua a leggere Osservare i raggi cosmici

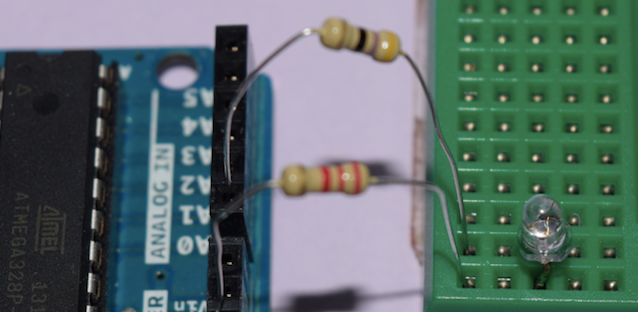

Un facile esperimento sull’effetto fotoelettrico

Oggi vi presento un facilissimo esperimento per osservare l'effetto fotoelettrico. Bastano pochi componenti elettronici facili da trovare: un LED che emetta luce verde dal corpo trasparente, una resistenza attorno al migliaio di Ohm e un voltmetro. In questo post ho usato, al posto del voltmetro, una scheda Arduino. L'effetto fotoelettrico consiste nell'emissione di elettroni da… Continua a leggere Un facile esperimento sull’effetto fotoelettrico